LiiADA Augmented Intelligence Framework

Un framework Python modular y plug-and-play para construir agentes de IA de grado de producción. Arquitectura hexagonal, soporte multi-LLM e integración nativa de contexto HCP — sin dependencias propietarias.

¿Por qué otro framework de agentes?

La mayoría de frameworks te dan herramientas para llamar LLMs. LiiADA te da un sistema para construir agentes que permanecen coherentes entre sesiones, se recuperan de errores de forma determinista y auditan cada decisión que toman.

Construido para equipos que no pueden permitirse alucinaciones en producción. Cada módulo del agente es testeable, intercambiable y observable de forma independiente.

Módulos plug-and-play

13 módulos independientes. Intercambia proveedores LLM, backends de memoria o motores RAG sin tocar la lógica de negocio.

Contexto persistente vía HCP

Integración nativa con el protocolo HCP. Los agentes leen y actualizan contexto estructurado automáticamente — sin más amnesia de sesión.

Observable por defecto

Cada decisión del agente se registra con trazabilidad completa. Métricas integradas y tracing compatible con OpenTelemetry.

13 Módulos Independientes

Cada módulo es una unidad ports & adapters — reemplazable sin cambiar el resto del sistema.

Framework base y contenedor DI

Ollama, OpenAI, Anthropic, Gemini

Memoria episódica + semántica

Sistema RAG multidominio

Motor de prompts estructurado

Capa de caché inteligente

Métricas, tracing, logging

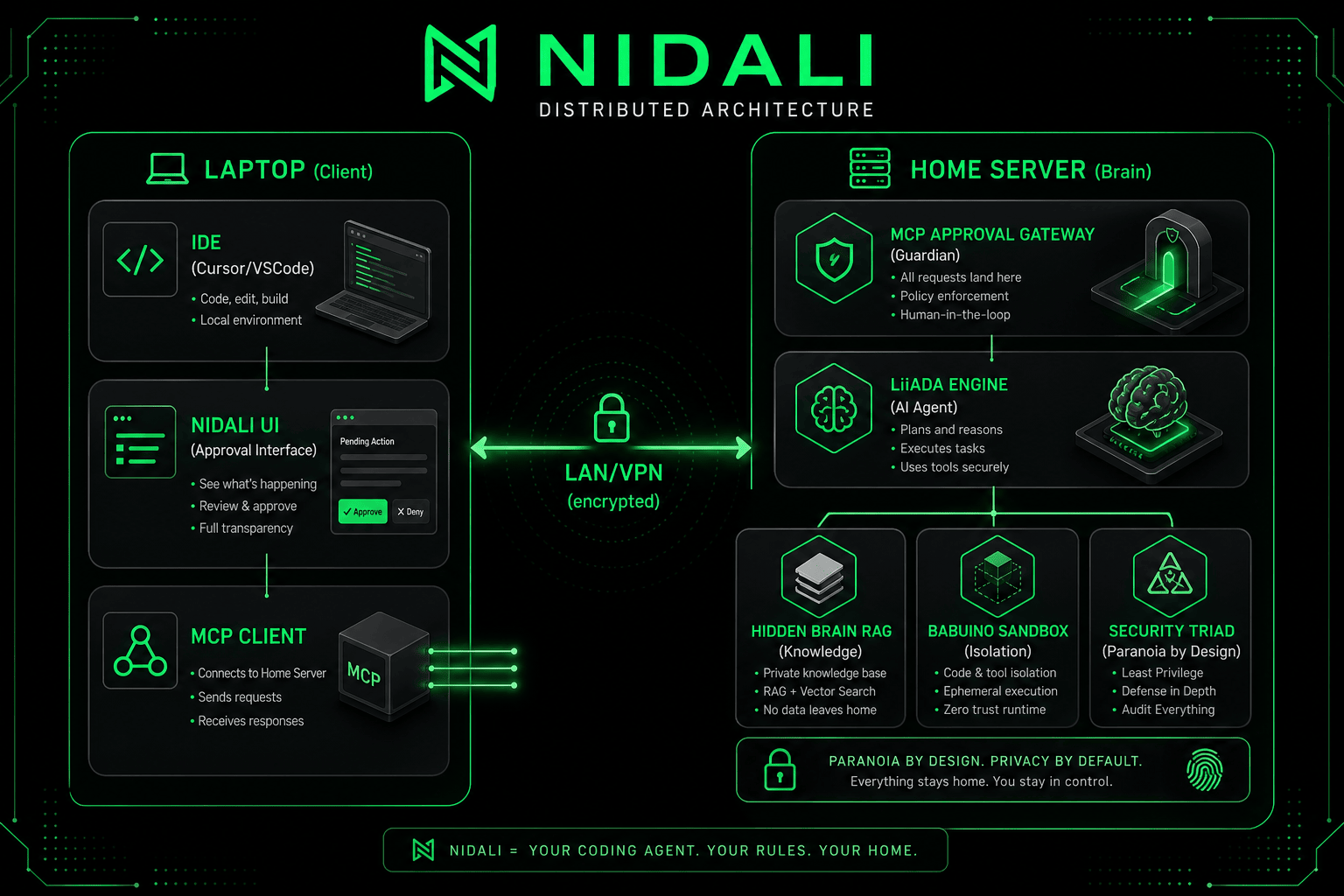

Integración protocolo MCP

Registro y ejecución de herramientas

Conectores de sistemas externos

Gestión de ciclo de vida de sesión

Rastro de auditoría de decisiones

Integración de contexto HCP

Agente Mínimo en 10 Líneas

Intercambia cualquier módulo sin tocar el resto.

from liiada.core import AgentBuilder

from liiada.llm import OllamaProvider

from liiada.memory import EpisodicMemory

from liiada.hcp import HCPContextLoader

agent = (

AgentBuilder()

.with_llm(OllamaProvider(model="llama3"))

.with_memory(EpisodicMemory())

.with_context(HCPContextLoader(vault=".procontext/"))

.build()

)

response = await agent.run("Implement the user auth endpoint")

# Agent reads .procontext/ → knows stack, decisions, constraintsCualquier LLM. Tu Infraestructura.

Sin dependencias propietarias. Ejecución totalmente local o híbrida.

Ollama (local)

OpenAI

Anthropic

Google Gemini

Lanzamiento Mayo 2026

Dale estrella al repo para recibir notificaciones cuando LiiADA sea público.